Em 26 de setembro de 1983, Stanislav Petrov, um tenente-coronel soviético, encontrava-se em sua posição de monitoramento dos sistemas de alerta nuclear quando recebeu uma notificação alarmante. O painel indicava que cinco mísseis nucleares haviam sido disparados dos Estados Unidos em direção à União Soviética. Petrov dispunha de apenas alguns minutos para decidir se acionava ou não a cadeia de comando que resultaria em um contra-ataque nuclear. Apesar de os protocolos exigirem uma resposta imediata à ameaça identificada, Petrov considerou que um ataque real provavelmente envolveria uma quantidade muito maior de mísseis. Em vez de acionar seus superiores, optou por aguardar, enfrentando o risco de uma decisão equivocada diante da possibilidade de uma falha tecnológica.

Posteriormente, ficou evidente que a alegada ameaça não era nada além de um erro causado por reflexos solares nas nuvens, que o sistema interpretou como lançamentos de mísseis inimigos. A escolha de Petrov impediu um conflito nuclear que poderia ter alterado o curso da história da humanidade. O caso ilustra de forma clara os desafios éticos e as limitações que podem surgir ao delegar decisões importantes a sistemas automatizados. A atitude de Petrov não foi apenas de desconfiança, mas uma interpretação cuidadosa do que significa interagir com sistemas inteligentes. Isso ocorre porque a inteligência digital não está apenas sendo criada, mas está coevoluindo com os seres humanos.

As fronteiras entre indivíduo e sistema se tornam flexíveis, e as tecnologias influenciam nossas decisões, estruturam nosso dia a dia e afetam a forma como percebemos o mundo. A questão central é: por que persistir no controle do progresso tecnológico como se ele estivesse isolado de nós? Pode ser o momento de considerá-la como um processo pós-darwiniano, no qual a seleção acontece entre sistemas híbridos, interconectados e interativos.

O que está em discussão hoje não é a humanização da tecnologia, mas a aceitação de que já fomos modificados por ela. O discurso sobre humanização pode parecer vazio se não considerarmos o quanto já nos transformamos em outros nesse processo. Como destaca Luciano Floridi em A Ética da Inteligência Artificial (PUCPRESS), é fundamental reconhecer que a revolução digital já ocorreu.

Ao contrário de outras transições históricas, a mudança de um mundo analógico e offline para uma realidade digital e conectada é inegável. A geração atual é a última a ter vivenciado um mundo não digital, o que nos impõe uma responsabilidade singular. O desembarque na infosfera não é apenas uma metáfora, mas a constatação de que estamos, pela primeira vez, em um ambiente formado por informações, interações e inteligências artificiais que moldam o presente e o futuro.

A ética da inteligência artificial não pode ser acessória, tardia ou contemplativa. Ela precisa ser proativa e orientadora. Não é suficiente perguntar se as direções tomadas pela inovação digital são corretas ou equivocadas. A ética digital deve antecipar e guiar o progresso da tecnologia, respeitando três critérios sucessivos: viabilidade, sustentabilidade ambiental e aceitabilidade social. A partir desse ponto, poderemos discutir coletivamente o que é preferível. Essa hierarquia de prioridades impede que decisões importantes sejam pautadas apenas por interesses financeiros, pelo fascínio técnico ou pela lógica da urgência.

Considerar a ética como um sistema de alerta precoce implica em entender que riscos identificáveis devem ser prevenidos antes que se transformem em prejuízos irreparáveis. Algumas falhas são irrecuperáveis e certas oportunidades perdidas não podem ser recuperadas. Qualquer mal que possa ocorrer é, por sua natureza, uma falha ética. Assim, as organizações que adotam uma abordagem ética da IA ganham uma vantagem dupla: reduzem seus riscos e aumentam sua legitimidade. Não é exagero afirmar que o custo do engajamento ético é amplamente superado pelo valor de sua contribuição.

Em suma, conhecer um conteúdo profundamente não se resume apenas a ser capaz de repeti-lo. Não é suficiente apenas conhecer algo; é preciso entender como manipulá-lo, operando suas estruturas internas, percebendo suas tensões e explorando seus mecanismos. Como afirma Floridi, redigir uma boa entrada na Wikipédia está se tornando cada vez mais automatizável; no entanto, para corrigi-la, é necessária uma compreensão que transcende a forma. Saber identificar onde está o erro, onde o argumento falha, onde o exemplo é simplista demais ou onde o conceito foi mal interpretado é sinal de domínio. O exercício ético mais importante pode ser o de não considerar o conteúdo como definitivo, mas manter o compromisso com sua revisão constante.

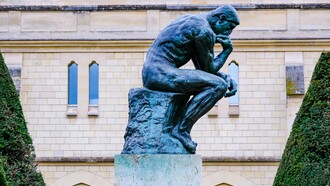

Petrov nos mostrou que o humano ainda é relevante, não como controle absoluto, mas como presença em meio a sistemas que aprendem, erram e decidem. Importa como alguém que, ao interagir com uma máquina, foi capaz de identificar as limitações tecnológicas e confiar na própria intuição, questionando a decisão automatizada. O que teríamos feito se estivéssemos na posição de Petrov? Que tipo de ser humano surge da simbiose com a IA? A IA respeita valores como dignidade humana, autonomia e responsabilidade social?