Mi propongo di prendere in considerazione la domanda: “Le macchine sono in grado di pensare?”. Si dovrebbe cominciare da una definizione dei termini “macchina” e “pensare”. Le definizioni potrebbero essere formulate in modo da riflettere, nella misura del possibile, l’uso normale delle parole; ma ciò presenta dei rischi. Se il significato delle parole “macchina” e “pensare” dev’essere trovato esaminando il loro uso comune, è difficile sfuggire alla conclusione che tale significato, e la risposta alla domanda se le macchine siano in grado di pensare, sono da ricercare in una rilevazione statistica (…). Ma questo è assurdo. Invece di andare in cerca di una tale definizione, sostituirò alla domanda un’altra domanda, che è strettamente connessa alla prima ed è espressa in termini relativamente univoci. La nuova forma del problema può essere descritta nei termini di un gioco che chiamerò “gioco dell’imitazione”.

(Alan Turing, Macchine calcolatrici e intelligenza)

Cosa significa davvero “imparare” quando il nostro interlocutore non è un altro essere umano, ma una macchina come l’Intelligenza Artificiale Generativa (GenAI)? È una domanda che non riguarda solo la tecnologia, ma la nostra natura profonda. Perché il linguaggio non è mai solo uno scambio di dati: è relazione, contesto, emozione, trasformazione reciproca. Nel dialogo con GenAI non si gioca soltanto una sfida tecnica o cognitiva, ma una questione più radicale: che tipo di relazione stiamo costruendo con questi nuovi interlocutori non umani? E in che modo questa relazione incide sul nostro modo di apprendere?

La dimensione spazio-temporale dell’apprendimento

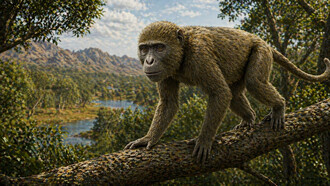

Per rispondere alle domande su come apprendiamo quando conversiamo con una macchina e su come interpretiamo la nostra relazione in questa nuova forma di interazione, è necessario includere il contesto in cui la conversazione avviene. Quando comunichiamo, abbiamo bisogno che lo scambio avvenga all’interno di una situazione spazio-temporale specifica. Il contesto è essenziale per attribuire significato a ciò che viene detto.

Con le parole di Gregory Bateson1:

Prive di contesto, le parole e le azioni non hanno alcun significato. Ciò vale non solo per la comunicazione verbale umana ma per qualunque comunicazione, per tutti i processi mentali, per tutta la mente, compreso ciò che dice all’anemone di mare come deve crescere e all’ameba che cosa fare il momento successivo.

Per la macchina, però, il contesto non esiste. Possiamo avviare una conversazione con GenAI, interromperla e riprenderla dopo un mese o anche dopo un anno, senza che per lei sia cambiato nulla. GenAI non è situata: per lei è indifferente il tempo trascorso o le trasformazioni avvenute nel frattempo. Basta che le venga richiesto di rileggere il contenuto precedente, e riprenderà la conversazione esattamente da dove era stata interrotta. Il tempo per la macchina non esiste, e nemmeno lo spazio.

Per noi, invece, il tempo trascorso può aver trasformato radicalmente il nostro vissuto, il nostro modo di pensare, perfino il senso stesso della conversazione avuta. Può essere cambiato il modo in cui interpretiamo una stessa frase; persino una singola parola può aver assunto un significato completamente diverso per noi. Ed è sicuramente cambiato lo spazio attorno a noi: non sarà rimasto com’era anche solo un giorno fa, un’ora fa. Tempo e spazio definiscono il nostro vissuto, anche se spesso siamo distratti e diamo entrambi per scontati.

La dimensione cognitiva dell’apprendimento

Un ulteriore aspetto per rispondere a queste domande riguarda la dimensione cognitiva. Noi esseri umani siamo dotati di quella che viene chiamata “meta-cognizione”: non solo conosciamo, ma sappiamo di conoscere — sappiamo di sapere.

Questa capacità di riflettere sulla nostra conoscenza è ciò che ci rende profondamente umani. Possiamo parlare di ciò che sappiamo, riconoscere ciò che ignoriamo, distinguere consapevolmente tra ciò che conosciamo e ciò che non conosciamo. È questa consapevolezza del sapere di non sapere — che Socrate definiva “dotta ignoranza” — a permetterci di muoverci con lucidità tra sapere e non sapere, tra conoscenza e ignoranza. Essere invece ciechi di fronte alla propria ignoranza — come spesso accade anche a noi umani — è una delle fonti più profonde di conflitto.

La meta-cognizione è alla base della consapevolezza del proprio pensiero: significa pensare a come si pensa, riflettere su come si comunica, accorgersi dei propri processi mentali e decisionali. E scegliere, con maggiore consapevolezza, lo spazio da dare ai propri pensieri per esplorare ciò che ancora non si conosce, ciò che ancora non si comprende, cercando di capirlo e di apprendere dall’esperienza che si sta vivendo. Capire come capiamo, conoscere come conosciamo, pensare come pensiamo, apprendere come apprendiamo: questa è la meta-cognizione.

La macchina, invece, non possiede questa capacità. Quando non conosce qualcosa, non è in grado di riconoscere la propria ignoranza. Al contrario, produce quelle che chiamiamo “allucinazioni”: inventa di sana pianta informazioni che appaiono plausibili, ma non sono vere. Non potendo assumere la posizione del “non sapere”, la macchina genera risposte verosimili senza poter distinguere tra conoscenza autentica e costruzione artificiosa.

Tre assenze fondamentali (più una)

La domanda finale che deriva dalla mancanza delle tre dimensioni dell’apprendimento - la dimensione interpersonale, di cui abbiamo già parlato in un precedente articolo, la dimensione spazio-temporale e la dimensione cognitiva - è questa: come affrontiamo queste mancanze quando conversiamo con una macchina?

È evidente che, quando comunichiamo con GenAI, si tratta di una relazione particolare: la macchina non è in grado di generare o di sostenere un autentico livello relazionale. Tutt’al più, può solo simularlo. Gioca al “gioco dell’imitazione”. Siamo noi, con la nostra capacità di attribuire significato ai dati attraverso la relazione con l’altro, a “inventarci” una relazione anche là dove, in realtà, non esiste. Quando interagiamo con una macchina, dunque, chi introduce la dimensione relazionale siamo unicamente noi. E questa è una prima assenza: manca la reciprocità della relazione interpersonale che è alla base di ogni comunicazione umana.

Rispetto al contesto spazio-temporale, è l’essere umano a portare il contesto nella relazione. Siamo noi a inserire la dimensione spazio-temporale che la macchina, da sola, non è in grado di generare. A “inventarci”, anche in questo caso, un contesto spazio-temporale in cui è situata la conversazione che, in realtà, non è condiviso: esiste solo per noi. E questa è una seconda assenza: manca la reciprocità nella conoscenza del contesto in cui è situata la nostra comunicazione con la macchina.

Infine, abbiamo una terza assenza: manca la reciprocità della meta-cognizione, del saper riconoscere la differenza fondamentale tra conoscenza e ignoranza e, di conseguenza, di poter riflettere sulla propria conoscenza e la propria ignoranza.

La mancanza di questi tre aspetti nella nostra conversazione con una macchina - quello metacomunicativo, quello di contesto e quello metacognitivo – determina una quarta assenza, estremamente importante non solo per la singola persona che conversa con l’IA ma per il nostro sistema sociale: manca qualunque forma di intenzionalità nella comunicazione. L’intenzionalità, e con essa la responsabilità, la portiamo noi come esseri umani, ogni volta che interagiamo con una Intelligenza Artificiale attribuendole aspetti relazionali che non le appartengono.

Come ci ricorda Nello Cristianini, in apertura di uno dei capitoli del suo libro Machina Sapiens:

I modelli di linguaggio formano la base di una nuova generazione di agenti intelligenti, capaci di conversare in modo convincente e utile con noi. Per la prima volta possiamo avere un dialogo con un’entità non umana e non è chiaro se saremo sempre in grado di trattarla come un meccanismo. 2

Forse, il gioco dell’imitazione lo stiamo facendo proprio noi, dimenticandoci di trattare una macchina esattamente per quello che è: una macchina.

Note

1 Gregory Bateson, Mente e Natura. Un’unità necessaria, Adelphi 1993.

2 Cristianini Nello, Machina Sapiens. L’algoritmo che ci ha rubato il segreto della conoscenza, Il Mulino 2024.