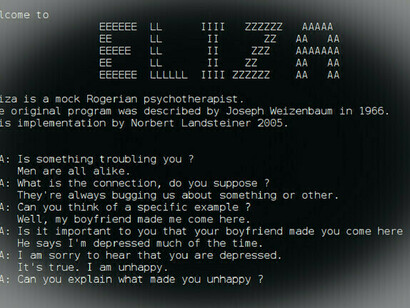

Il primo chatbot, un piccolo software con il quale veniva simulata per la prima volta una conversazione con una voce che sembrava umana, fu sviluppato nel 1966 e venne chiamato Elisa. Da quel momento la crescita dell’intelligenza artificiale avvenne in modo sempre più veloce. Si svilupparono algoritmi sempre più sofisticati, dando via a quella che oggi definiamo Intelligenza Artificiale (IA) o Artificial intelligence (AI).

Le chatbot le utilizziamo ormai da anni, spesso senza rendercene conto, come assistenti domestici, come Google Home e Amazon Alexa, per attivare impianti ed elettrodomestici, li utilizziamo come navigatori sulle auto o nei telefoni cellulari, ecc. Con livelli più avanzati si sono ottenuti sistemi di guida aerea con pilota automatico e importanti esperimenti sulle automobili senza guidatore.

Questo articolo è desunto da una mia nota che ho avuto l’onore di presentare al Simposio su "Intelligenza artificiale. Una sfida per l’umanità" tenutosi a Roma il 30 marzo 2023.1

L’avvento delle ChatGPT

Di recente è stato realizzato un sistema di intelligenza artificiale che consente di scrivere articoli, email e poesie, creare post social, correggere errori matematici, ecc. Macchine che tentano di imitare il funzionamento del cervello umano attraverso reti neurali artificiali (artificial neural networks), che curano l’apprendimento immagazzinando una grandissima quantità di dati disponibili sul web. Tale nuovo sistema, sviluppato dalla OpenAI, un’organizzazione non profit sulla ricerca dell’IA e sulla sua promozione della GPT, è stato chiamato Chat Generative Pre-trained Transformer (GPT) o semplicemente ChatGPT.

Dalle macchine per apprendimento automatico (machine learning) si è passato alle macchine per apprendimento profondo (deep learning), di cui l’ultima generazione è rappresentata dalle ChatGPT4. Con quest’ultimo livello d’intelligenza artificiale, attraverso algoritmi di ultima generazione, la macchina ha la capacità di arricchirsi sempre più automaticamente di dati dal web (testi, immagini e suoni) senza l’aiuto dell’uomo per la loro ricerca e il loro immagazzinamento e di elaborali, riuscendo a rispondere con nuovi potenti algoritmi. È un software che sa rispondere alle domande e conversare, sa rispondere a test di medicina o per avvocati, commettendo molti meno errori dell’uomo.

Una scoperta che preoccupa alcuni

Una crescente preoccupazione invade l’umanità intera per la velocità con cui si afferma sempre più l’intelligenza artificiale (IA), in particolare per l’alto livello raggiunto da ChatGPT4. È il nostro stesso uso continuo che ne facciamo inconsciamente da anni che sta partecipando ad accelerare lo sviluppo di tale intelligenza, poiché arricchisce sempre più i potenti data base dove sono allocati i miliardi di dati già esistenti e utilizzati dall’IA. Ormai ci sembra un fatto normale parlare al nostro cellulare e vedere che le nostre parole vengono trasformate in frasi, corrette grammaticalmente, e tradotte nella lingua che desideriamo, compreso arabo o cinese. Parlare al nostro televisore per farci selezionare il film o la musica di nostro gradimento.

Quando usiamo i nostri cellulari per scrivere un testo passa ormai quasi inosservato che le parole delle nostre frasi spesso ci vengono anticipate automaticamente, che una ricerca su internet è sempre più veloce e ci suggerisce una quantità di notizie sempre maggiore. E non si tratta forse di intelligenza artificiale a cui siamo ormai assoggettati?

A conferma di tale assuefazione è la nostra poca attenzione alle conseguenze che si stanno registrando in tutto il mondo come causa dell’IA.

Le rassicurazioni di Bill Gates

Bill Gates il 21 marzo 2023 ha pubblicato su un suo blog un pensiero sull’IA, mettendo in risalto soprattutto i lati positivi e il fatto che l’IA diventerà un vero supporto dell’uomo e l’aiuterà nelle sue attività lavorative. Viene fatto anche un breve cenno sui lavoratori che dovranno comunque modificare le loro attività quando esse vengono sostituite dall’IA. Sono descritti anche i grandi benefici che ne avrebbero i popoli, soprattutto quelli più poveri, nell’assistenza sanitaria e nell’istruzione. L’articolo nel suo complesso è fortemente ottimista e mette in risalto che l’IA migliorerà la vita degli umani.

In definitiva oggi non solo Bill Gates, ma tutta l’umanità sembra plaudire per gli alti progressi raggiunti e ai quali si è ormai adattata, anche perché la crescita dell’IA e il relativo impatto sociale sono risultati ancora sostenibili.

La preoccupazione è però di recente tornata alla ribalta, soprattutto perché non si conoscono ancora i veri limiti che potrà realmente raggiungere l’IA in questa sua crescita vertiginosa, anche perchè spesso si legge che essa potrà sostituire la mente umana con capacità operative di gran lunga superiori. In un commento pubblicato sul citato blog di Bill Gates da parte di un lettore è scritto:

Ho tanta paura di ciò che gli umani possono fare con tale tecnologia e di ciò che una tecnologia pensata dagli umani può fare da sola. Ho visto dittatori, radicali religiosi, grandi aziende inquinanti, "conquistatori" dello spazio, folle, cartelli della droga e molti altri in una posizione di potere, e credetemi useranno l'IA per i propri scopi malvagi/umani. Spero solo di non riuscire a vedere la fine dell'umanità a causa dell'intelligenza artificiale.

Un timore sicuramente condivisibile, pertanto, è normale chiederci se tale “progresso”, al di là dei vantati benefici che ne derivano, sarà veramente un bene o una vera fonte di preoccupazione per l’umanità, se, ad esempio, potrà risolvere i problemi occupazionali legati agli aspetti alimentari, alle guerre, alle risorse energetiche, agli sfruttamenti umani e dei beni materiali naturali esistenti, alla sicurezza internazionale o se, invece, potrebbe incrementare tali problemi diventando un boomerang.

La dinamica delle innovazioni tecnologiche

Nei decenni scorsi i cambiamenti, ancorché rapidi, sono stati accettati dall’uomo con processi evolutivi anch’essi veloci che, quasi di pari passo, seguivano la velocità dell’evoluzione tecnologica. È evidente che questa tecnologia potrà essere utilizzata per una miriade di attività che potrebbero venire in aiuto dell’uomo più di quanto oggi già accade. Ma allora perché tanta preoccupazione?

Una forte attenzione è stata di recente posta alle conseguenze che potrebbero derivare da queste ultime scoperte e soprattutto dall’ancora poco chiaro limite massimo che esse potrebbero raggiungere, anche perché spesso si sente parlare della realizzazione di un’IA che dovrebbe simulare perfettamente la mente umana, superando le sue capacità per velocità delle risposte e per la vastità dei dati non contenibili nella memoria umana.

La ricerca non si deve trasformare in una sfida a Dio

La ricerca rivolta verso l’infinito è sempre stata la massima e legittima ambizione dell’uomo. Quasi un modo per misurarsi con chi tutto ciò ha creato. È come una sete insaziabile che ha l’uomo di potere conoscere ciò che sta oltre, infatti, il desiderio di superare ciò che già conosce è stata la molla più importante dell’evoluzione tecnologica. Ciò a mio avviso è il frutto della naturale aspirazione dell’uomo, sia sotto l’aspetto fisico che spirituale, perché ciò contribuisce nell’uomo alla sua crescita interiore.

Ma l’aspirazione è da ritenere legittima fin quando si è nella consapevolezza dell’impossibilità di potere costruire un robot con caratteristiche generali simili o superiori a quelle dell’uomo. Per un credente di qualunque religione una tale aspirazione significherebbe l’arroganza di volere superare ciò che il Creatore ha realizzato. Un’arroganza che potrebbe fare perdere temporaneamente all’uomo i confini della realtà accessibile, creandogli delle pericolose illusioni e ponendolo nelle condizioni di volere attuare una vera sfida a Dio. Nel cristianesimo l’angelo bellissimo che con ambizione e arroganza sfidò Dio venne cacciato dall’Eden e venne chiamato Satana.

I pericoli potenziali dell’esponenziale crescita dell’IA

Poiché vengono elogiati spesso solo gli aspetti positivi dell’IA, di seguito metterò in evidenza alcuni potenziali aspetti negativi per l’umanità che potrebbero derivarne soprattutto da un suo indiscriminato uso.

Perdita di posti di lavoro e aumento delle diseguaglianze

La prima e forse la più importante conseguenza potrebbe essere quella della creazione di macchine sempre più sofisticate che sostituiranno sempre più l’uomo nell’espletamento delle attività lavorative, creandogli naturali disagi e preoccupazioni. Infatti, è ben noto che negli ultimi anni la vertiginosa crescita demografica e la sostituzione di attività lavorative umane con macchine intelligenti hanno portato ad un notevole incremento della disoccupazione.

Le prime notizie sembravano mitigare tale preoccupazione, perché con l’avvento dell’IA si prospettava di convertire alcune attuali attività umane con attività umane di livello superiore. La riconversione, purtroppo, è avvenuta solo in minima parte interessando principalmente persone che avevano già cultura e predisposizione per l’accesso ad attività di livello scientifico superiore. Da evidenziare poi che la velocità delle nuove scoperte in tale materia non ha consentito all’uomo di evolversi di pari passo e tale divario tenderà sempre più ad aumentare, causando un incremento delle diseguaglianze che si manifesterà in maniera differente nei diversi paesi del mondo, soprattutto in relazione al loro attuale stato sociale, economico e culturale.

Incremento delle migrazioni

La perdita di posti di lavoro con IA, che sta già avvenendo nei paesi più evoluti, nei paesi con un alto tasso di povertà e analfabetismo sarà sicuramente devastante. E poiché la tendenza internazionale è di occupare sempre più potere economico in detti paesi, spesso ricchi di materie prime molto appetibili, è verosimile ipotizzare che in detti paesi il lavoratore tradizionale correrà il rischio di ridurre le già minime possibilità che ha di accesso al lavoro.

In tal modo la sua figura si ridurrebbe a quella di un essere vivente la cui presenza sarà sempre meno necessaria e forse anche meno opportuna in quanto tenderebbe a destabilizzare il potere dei sistemi forti locali e internazionali. La povertà potrà così diventare anche una causa scatenante di tensioni interne, di sommosse di difficile controllo e talvolta di vere guerre civili.

Non bisogna sottovalutare il fatto che questi popoli poveri, con le nuove generazioni che vivono in condizioni limite per la loro sopravvivenza, hanno una forte crescita demografica e sono sempre più indignati di quel che accade attorno a loro. Condizioni queste che non sono certamente foriere di stabilità e di pace, ma quasi certamente cause principali per incrementare l’emigrazione.

L’incrudimento mentale

La ricerca procede speditamente e in maniera automatica da parte dell’IA, che a sua volta, con l’alto livello tecnologico raggiunto, potenzierà sempre più e automaticamente la velocità di ricerca e di memorizzazione di nuovi dati, formandosi quasi un circuito di autoesaltazione del fenomeno, una sorta di quella che in fisica si chiama “risonanza”: maggiori dati si accumulano automaticamente, maggiore diventa la capacità operativa dell’IA per la ricerca, la raccolta e l’elaborazione di nuovi dati.

Di conseguenza sarà sempre meno necessario stimolare la mente umana nell’attività di ricerca, in quanto la stessa ricerca sarebbe in parte realizzabile direttamente dall’IA.

Ciò porterà sempre più ad una sorta di incrudimento delle menti umane, creandosi nel tempo un vero processo di involuzione e la forte riduzione della capacità produttiva umana. Tale perdita non sarà facilmente recuperata con l’IA, qualunque sarà la sua alta performance, perché essa non potrà mai tenere conto di aspetti congeniti delle menti umane, né di aspetti politico sociali dei singoli uomini la cui variabilità è elevatissima.

La gestione della sicurezza informatica

La cybersecurity, cioè la capacità di tutela e controllo dei sistemi informatici, rappresenterà uno dei grandi problemi legati anche all’IA. La sicurezza informatica sarà il solo strumento in grado di limitare i rischi, anche se involontari, di una diffusione anomala delle azioni dell’IA. Azioni che potrebbero portare, come caso limite, all’auto distruzione dell’umanità o alla distruzione programmata di parte di essa.

Non è da escludere che siamo così affascinati dai benefici apportati e apportabili dall’IA da evidenziare solo o principalmente gli aspetti positivi derivanti dalla sua attuazione e trascurare la sicurezza e gli enormi pericoli che ne possono derivare dal suo eventuale uso improprio. Una volta si diceva “chi possiede le chiavi del web ha le chiavi del mondo” e tale previsione si è già messa in atto quando, ad esempio, per brevi periodi alcune principali reti informatiche sono state bloccate per un guasto o volutamente. È evidente che in tali condizioni si può fermare il mondo intero o una grande parte di esso.

Estendendo tale concetto è facile ipotizzare cosa potrebbe accadere se il massimo livello di IA fosse lasciato in mano ad una sola persona o ad un solo paese. La cosiddetta pace armata si amplierebbe, ma in tal caso chi avrà il coltello dalla parte del manico sarà sempre chi per primo raggiungerà gli alti livelli dell’IA, perché ne avrà il pieno controllo. Purtroppo, la storia insegna che la bramosia del potere può fare commettere azioni riprovevoli e forse quasi inimmaginabili.

Sicurezza significa anche maggiori probabilità di pace. Pertanto, ci siamo chiesti, ad esempio, se l’IA saprà mediare problemi di pace o saprà fare le scelte giuste nel momento in cui dalle sue decisioni potrebbe derivare la vita o la morte di centinaia di persone? Le scelte certamente non seguiranno un’etica, né una vera coscienza, ma procederanno per raggiungere obiettivi programmati da quelli che hanno effettuato le metodologie di arricchimento dei dati, della loro selezione e della loro comparazione in caso di scelte.

Potenziali freni all’espansione indiscriminata dell’IA

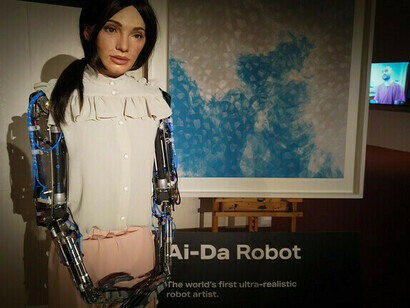

La nascita delle ChatGPT ha fatto immediatamente pensare alla possibilità di creare un robot con capacità superiori a quelle umane. Sembra però che ciò non sia realizzabile, tranne che il robot non abbia o comunque possa acquisire alcune specifiche capacità umane quali una coscienza, un’empatia, un’intuizione, una capacità introspettiva, un codice etico, ecc. come di seguito è brevemente richiamato.

Robot e coscienza

Come potrà mai un robot avere una sua coscienza, quella stessa coscienza che dà all’uomo la consapevolezza di sé stesso e dei rapporti col mondo esterno in cui vive, di autocontrollo e di autoregolazione, che gli permette di mediare tra i tanti stimoli e le tante sensazioni che riceve dal mondo in cui vive e che sono variabili per ogni uomo? Per avere una coscienza occorre che il robot possa ricevere e riconoscere delle sensazioni e delle emozioni attraverso la percezione visiva, uditiva e olfattiva e possa avere la capacità di elaborarli sapendo individuare le relazioni che esistono tra l’ambiente circostante e ogni singolo individuo.

Per ottenere ciò non sembra sia sufficiente avere la capacità di gestire la miriade di informazioni disponibili, che sono di gran lunga superiori a quelle che può contenere la mente umana, ma occorrerebbe un algoritmo, che simulando l’uomo, riuscisse a fare distinguere il bene dal male, agendo come per l’uomo anche attraverso quel tipo di spiritualità che guida ciascun uomo in relazione agli aspetti materiali della vita. L’IA potrà mai avere questo tipo di coscienza, tipica della capacità umana, che attraverso la formazione della coscienza morale possa guidare le sue azioni verso aspetti etici?

Robot e empatia

Se l’uomo ha bisogno di aiuto potrà l’IA intervenire positivamente? Potrà l’IA avere un’empatia, cioè la capacità di capire, senza alcuna specifica richiesta, e rispettare l’uomo e di relazionarsi con lui in uno spirito di collaborazione e di reciproco rispetto?

Il robot, per comprendere l’uomo in caso di un suo bisogno, dovrebbe avere la capacità di mettersi nei suoi panni, ma per fare ciò dovrebbe innanzitutto avere la capacità di provare proprie emozioni, ciò gli consentirebbe di riconoscere anche le emozioni degli altri e in particolare dell’uomo. Tra gli umani, ad esempio, l’empatia si manifesta anche attraverso un semplice sguardo che può trasmettere una forte emozione o un particolare stato d’animo. D’altra parte basta risalire all’origine della parola per comprendere se ciò è ipotizzabile per un robot. La parola deriva dal greco en-pathos che, tradotto letteralmente, significa “sentire dentro”. Non sembra ancora ipotizzabile che un robot possa sentire un così intenso sentimento da riuscire a provare un’emozione che è poi diversa per ogni uomo.

Robot e intuizione

L’uomo è dotato della capacità di intuire e l’intuizione spesso viene repressa dalla razionalità, ma l’intuito non è fondato su ragionamenti, poiché proviene principalmente dal subconscio, dunque utilizza esperienze personali che non possono essere inserite nel data base generale che utilizza l’IA che raccoglie dati provenienti dal mondo del web.

È ancora poco chiara la conoscenza di come funzione l’intuizione nell’uomo, sappiamo che la conoscenza razionale è impostata sulle informazioni che raccogliamo e sul modo in cui le elaboriamo, ma non sappiamo molto sul funzionamento della conoscenza intuitiva, oltre quali siano le parti del cervello in cui essa viene elaborata. Inoltre, non è possibile acquisire dati certi sulle origini dell’intuizione utilizzando quelli provenienti da un dato individuo per poi inserirli nella raccolta generale dei dati utilizzabili dall’IA per estenderli poi ad altri individui con caratteristiche ben differenti.

Robot e introspezione

Perché avvenga un processo di introspezione, cioè di osservazione di fatti della propria coscienza, l’individuo deve allontanarsi dal pensiero razionale, da quello analitico, per potere fare delle valutazioni senza alcun condizionamento esterno.

Ciò è possibile con la meditazione, attraverso la quale la mente umana rilassata riesce a valutare, senza condizionamenti, aspetti sociali difficilmente valutabili nelle condizioni normali della vita quotidiana. Ma sappiamo che gli elementi essenziali per una corretta introspezione sono: una buona capacità di riflettere su sé stessi, riuscire a provare empatia e possedere una buona intelligenza emotiva con cui si riconoscono, utilizzano e si comprendono le proprie emozioni e quelle degli altri.

Mancanza di un codice etico

Se l’IA mira a sostituire l’uomo con delle macchine potranno mai dette macchine rispettare un codice etico nei loro rapporti con gli uomini? In particolare, come agiranno in materia di sicurezza nelle attività che dovranno svolgere, ben sapendo che la poca sicurezza tra le macchine nel loro operare potrebbe avere immediate ripercussioni sull’uomo e sulla sua integrità fisica?

Si dirà: “è andato in tilt un circuito, pertanto la macchina ha creato un disastro ancor prima che venisse automaticamente o con interventi umani resa innocua”. E se il tilt interessa le decisioni sull’attivazione di un armamento militare o nucleare a cosa servirebbero le eventuali scuse e/o giustificazioni postume?

Da alcune notizie sembra che la macchina gestita dall’IA abbia in definitiva meno possibilità di sbagliare di un essere umano, ma l’essere umano in situazioni strategiche si consulta con altri uomini che si esprimeranno poi secondo un’etica ed una coscienza. Cosa farebbero i robot in tali occasioni? Potrebbero fare un veloce consulto? Ma se sono tutti frutto dell’elaborazione degli stessi dati gestiti con gli stessi algoritmi le risposte non potrebbero essere divergenti, quindi sarebbe superfluo il consulto. In tali casi strategici siamo certi che la scelta algoritmica sarebbe quella più corretta o comunque meno pericolosa?

In generale, se l’IA si dovrà relazionare con degli uomini sarà in grado di affrontarli riconoscendone il loro valore, la loro dignità, la loro funzione umana? Potrebbe avere quell’autonomia e capacità per potere assumere decisioni per affrontare situazioni di bisogno o di disagio nei confronti dell’umano, avendo essa stessa di fatto sostituito gli umani? Forse potremmo riscontrare un aspetto positivo determinato dal fatto che l’IA potrà affrontare il suo lavoro senza alcuna discriminazione di etnia, di nazionalità, di religione, di sesso, di condizione sociale, di ideologia politica o comunque di qualsiasi altra differenza o caratteristica personale. Sempre che l’algoritmo da cui dipende la sua attività non venga manomesso o indirizzato verso altri fini da parte di chi gestisce l’algoritmo o di chi dovrebbe gestire la sicurezza.

Limiti dell’IA che al momento sembrano irraggiungibili

Le capacità brevemente esposte non sembrano al momento acquisibili da parte dell’IA. Il limite da raggiungere dovrebbe essere quello di una macchina perfetta, con algoritmi in grado di valutare esperienze derivanti da aspetti sociali, da aspetti politici e da tradizioni maturate da ogni essere umano. Se ciò fosse realmente possibile si aprirebbe un baratro per l’umanità, perché avremmo una macchina capace di provare emozioni e reagire a stimoli che tenderebbero ad annullare la stessa necessità dell’intervento umano e a limite l’uomo stesso.

E per il rispetto dei diritti umani, sarà l’IA a decidere ciò che è bene o ciò che è male e in funzione a cosa? In definitiva, sarà dunque l’IA a decidere ciò che è morale, ben sapendo che non c’è una morale universale? L’IA, non potendo acquisire le singole esperienze di tutti gli uomini, penserà sempre e solo in funzione dei dati in suo possesso e degli input ricevuti e derivanti da precisi interessi economici e politici di chi la gestisce, si tenderebbe dunque ad annullare qualunque forma di umanità, facendo emergere sempre più l’interesse economico e la sete di potere e di conseguenza le diseguaglianze.

Sembra comunque che non ci sia ancora alcuna prospettiva concreta per dotare l’IA di tali capacità e soprattutto che possa essere creato l’algoritmo della genialità, una dote che resta strettamente legata ad alcuni uomini e che non è trasferibile da un uomo all’altro. Mi sono anche chiesto se esite un limite a questo processo tecnologico, cioè se è stato pensato un limite o se si pensa che il limite vero sia la clonazione umana attraverso una macchina con IA.

Intervento in Italia del Garante per la protezione dei dati personali

Con provvedimento n. 112 del 30 marzo 2023, in Italia, il Garante per la protezione dei dati personali ha bloccato l’uso di ChatGPT4 principalmente perché «non viene fornita alcuna informativa agli utenti, né agli interessati i cui dati sono stati raccolti da OpenAI, L.L.C. e trattati tramite il servizio di ChatGPT» e perché non c’è alcun controllo sull’accesso ai dati da parte dei minori, ecc. Questo provvedimento è stato pesantemente criticato, soprattutto da quanto lo hanno valutato come un impedimento all’evolversi delle nuove tecnologie. La sospensione dell’uso di Chat GPT4 per la sua complessità e per non appesantire il presente articolo, si ritiene opportuno trattarla successivamente.

Considerazioni finali

L’IA è frutto dell’ingegno dell’uomo e può diventare un importantissimo e indispensabile strumento portatore di bene e di mezzo opportuno per schivare eventi disastrosi o per limitarne i danni. Non possiamo sottovalutare che tanti disastri, dovuti, ad esempio, a cedimento strutturale di dighe e di viadotti potevano essere evitati e potevano essere salvate tante vite umane se solo ci fosse stata la possibilità di un controllo adeguatamente monitorato e una adeguata e veloce interpretazione dei dati nei tempi utili precedenti i disastri; attività e controlli oggi in massima parte gestibili attraverso l’IA.

Il presidente di Microsoft, Brad Smith, nell’incontro avuto in Vaticano con Papa Francesco il 13 febbraio 2019 disse in relazione all’IA, come pubblicato su RAI NEWS del 13 febbraio 2019:

Nelle mani sbagliate ogni strumento può diventare un’arma se la potenza organizzativa dell’umanità non riesce a tenere il passo con la tecnologia stessa. Per garantire che le persone abbiano fiducia nella tecnologia, dobbiamo pensare oltre la tecnologia stessa; abbiamo bisogno di forti principi etici, di nuove leggi evolute, di una formazione di persone con nuove competenze e persino riforme del mercato del lavoro. Se vogliamo sfruttare al massimo la potente e promettente tecnologia dell'intelligenza artificiale, tutto ciò deve venire insieme.

Ciò significa che i benefici si potranno ottenere solo se le innovazioni sociali avverranno contemporaneamente all’evolversi dell’IA, cosa non certamente facile data la crescita esponenziale delle capacità dell’IA rispetto l’adattamento dell’uomo nei suoi processi evolutivi. Il pericolo potrebbe diventare reale se l’individuo, preso da un delirio di onnipotenza, volesse tentare di sostituirsi a Dio. E, a tale scopo, non è certo casuale se il 10 gennaio 2023 in Vaticano, tra i rappresentanti delle tre religioni abramitiche, è stata sottoscritta la “Call for AI Ethics” con cui vengono assunti i seguenti impegni per uno sviluppo etico dell’IA:

- Trasparenza: in linea di principio, i sistemi di IA devono essere chiari e spiegabili.

- Inclusione: le esigenze di tutti gli esseri umani devono essere prese in considerazione affinché tutti possano trarre beneficio e a tutti gli individui possano essere offerte le migliori condizioni possibili per esprimersi in modo costruttivo.

- Responsabilità: chi progetta e utilizza l'IA deve farlo in modo responsabile e con trasparenza.

- Imparzialità: gli strumenti di IA non dovrebbero essere sviluppati con pregiudizi, ma dovrebbero sforzarsi di essere equi, onesti e di proteggere la dignità umana.

- Affidabilità: occorre fare ogni sforzo per garantire che i sistemi di IA funzionino in modo affidabile.

- Sicurezza e privacy: I sistemi di IA devono garantire la sicurezza e rispettare la privacy degli utenti.

Si tratta dunque di un documento importantissimo, dove emergono tutte le nostre paure, idoneo per promuovere una «algoretica», ovvero uno sviluppo etico dell’intelligenza artificiale, attraverso la creazione di un adeguato algoritmo. Infatti

le implicazioni sociali ed etiche delle AI e degli algoritmi rendono necessaria tanto un algor-etica quanto una governance di queste invisibili strutture che regolano sempre più il nostro mondo per evitare forme disumane di quella che potremmo definire una algo-crazia.2

Resta, comunque, il dubbio se ci sarà mai la possibilità di mettere in atto questo programma mediando le esigenze tecnologiche e tenendo conto che l’uomo ha anche una parte spirituale che non potrà mai essere realizzata con alcun particolare algoritmo.

La sfida dell’IA è ormai ad un livello molto avanzato dal quale non si può più tornare indietro. Resta da chiedersi che ne sarà della coscienza umana, se sarà in grado di controllare o comunque di mitigare lo sviluppo dell’IA perchè tale sviluppo non sfugga al controllo umano e il progresso tecnologico non si trasformi in una vera sfida che l’uomo lancia a Dio.

Note

1 Al Simposio, organizzato dal Comitato Promotore di cui fanno parte, oltre a Roberto Savio Direttore di Other News, Sergio Bellucci, Lucio Pascarelli, Bruno Quinzi, hanno partecipato eminenti studiosi nazionali e internazionali che hanno fatto emergere le più importanti criticità legate al recente livello raggiunto dall’Intelligenza Artificiale e alle conseguenziali preoccupazioni umane.

2 Paolo Benanti, Oracoli. Tra algoretica e algocrazia, Roma, Luca Sossella editore, 2018. Paolo Benanti è frate francescano del Terzo Ordine Regolare e docente di Teologia morale e Bioetica alla Pontificia Università Gregoriana.